Page 10 - 电力与能源2023年第五期

P. 10

432 李 盖,等:基于 LSTM 组合模型的短期电力负荷预测

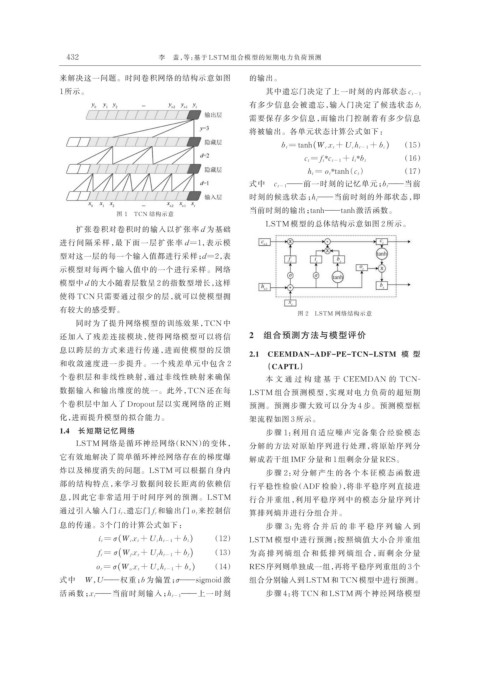

来解决这一问题。时间卷积网络的结构示意如图 的输出。

1 所示。 其中遗忘门决定了上一时刻的内部状态 c t - 1

有多少信息会被遗忘,输入门决定了候选状态 b t

需要保存多少信息,而输出门控制着有多少信息

将被输出。各单元状态计算公式如下:

b t = tanh(W c x t + U c h t - 1 + b c) (15)

(16)

c t = f t*c t - 1 + i t*b t

h t = o t*tanh ( c t ) (17)

式中 c t - 1——前一时刻的记忆单元;b t——当前

时刻的候选状态; h t——当前时刻的外部状态,即

当前时刻的输出; tanh——tanh 激活函数。

图 1 TCN 结构示意

LSTM 模型的总体结构示意如图 2 所示。

扩张卷积对卷积时的输入以扩张率 d 为基础

进行间隔采样,最下面一层扩张率 d=1,表示模

型对这一层的每一个输入值都进行采样;d=2,表

示模型对每两个输入值中的一个进行采样。网络

模型中 d 的大小随着层数呈 2 的指数型增长,这样

使得 TCN 只需要通过很少的层,就可以使模型拥

有较大的感受野。 图 2 LSTM 网络结构示意

同时为了提升网络模型的训练效果,TCN 中

还加入了残差连接模块,使得网络模型可以将信 2 组合预测方法与模型评价

息以跨层的方式来进行传递,进而使模型的反馈

2.1 CEEMDAN-ADF-PE-TCN-LSTM 模 型

和收敛速度进一步提升。一个残差单元中包含 2 (CAPTL)

个卷积层和非线性映射,通过非线性映射来确保 本 文 通 过 构 建 基 于 CEEMDAN 的 TCN-

数据输入和输出维度的统一。此外,TCN 还在每 LSTM 组合预测模型,实现对电力负荷的超短期

个卷积层中加入了 Dropout 层以实现网络的正则 预测。预测步骤大致可以分为 4 步。预测模型框

化,进而提升模型的拟合能力。 架流程如图 3 所示。

1.4 长短期记忆网络 步骤 1:利用自适应噪声完备集合经验模态

LSTM 网络是循环神经网络(RNN)的变体, 分解的方法对原始序列进行处理,将原始序列分

它有效地解决了简单循环神经网络存在的梯度爆 解成若干组 IMF 分量和 1 组剩余分量 RES。

炸以及梯度消失的问题。LSTM 可以根据自身内 步骤 2:对分解产生的各个本征模态函数进

部的结构特点,来学习数据间较长距离的依赖信 行平稳性检验(ADF 检验),将非平稳序列直接进

息,因此它非常适用于时间序列的预测。LSTM 行合并重组,利用平稳序列中的模态分量序列计

通过引入输入门 i t、遗忘门 f t 和输出门 o t 来控制信 算排列熵并进行分组合并。

息的传递。3 个门的计算公式如下: 步 骤 3:先 将 合 并 后 的 非 平 稳 序 列 输 入 到

i t = σ (W i x t + U i h t - 1 + b i) (12) LSTM 模型中进行预测; 按照熵值大小合并重组

f t = σ (W f x t + U f h t - 1 + b f) (13) 为 高 排 列 熵 组 合 和 低 排 列 熵 组 合 ,而 剩 余 分 量

o t = σ (W o x t + U o h t - 1 + b o) (14) RES 序列则单独成一组,再将平稳序列重组的 3 个

式中 W, U——权重; b 为偏置; σ——sigmoid 激 组合分别输入到 LSTM 和 TCN 模型中进行预测。

活函数; x t——当前时刻输入; h t - 1——上一时刻 步骤 4:将 TCN 和 LSTM 两个神经网络模型